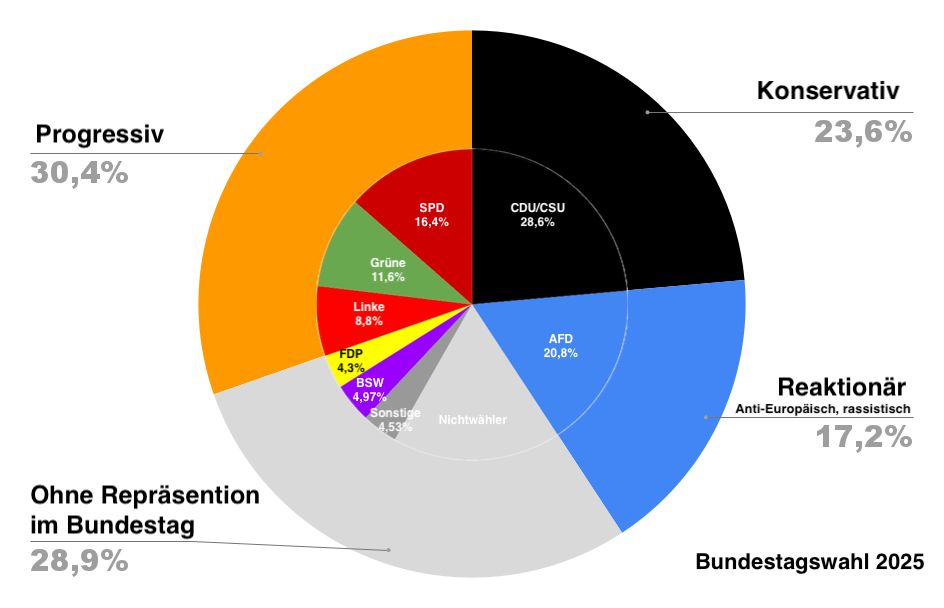

Die dem. Parteien des Bundestags repräsentieren nur 54% der deutschen Wahlberechtigten.

Es sind mehr Stimmen ohne Repräsentanz im BT, als auf die Union entfallen. Trotz höchster Wahlbeteiligung im wiedervereinigten Deutschland!

Die dem. Parteien des Bundestags repräsentieren nur 54% der deutschen Wahlberechtigten.

Es sind mehr Stimmen ohne Repräsentanz im BT, als auf die Union entfallen. Trotz höchster Wahlbeteiligung im wiedervereinigten Deutschland!

Nur wenn wir den Wert von ‚human generated content‘ im Trainingsset erkennen, wird sich die Wertschöpfung des Models verteilen, statt nur dem Model owner zuzufallen.

Nur wenn wir den Wert von ‚human generated content‘ im Trainingsset erkennen, wird sich die Wertschöpfung des Models verteilen, statt nur dem Model owner zuzufallen.

Nimm zwei identische LLMs, eins mit NYT Artikeln, eins ohne. Du wirst Unterschiede in den Completions sehen. Gerade bei Themen, die dort stark repräsentiert sind.

Nimm zwei identische LLMs, eins mit NYT Artikeln, eins ohne. Du wirst Unterschiede in den Completions sehen. Gerade bei Themen, die dort stark repräsentiert sind.

Dann generiert die GenAI zu diesem Thema nichts sinnvolles, sondern halluziniert.

Wenn du ihr nun Traingsdaten zu dem Thema gibst, werden die Outputs besser.

Dann generiert die GenAI zu diesem Thema nichts sinnvolles, sondern halluziniert.

Wenn du ihr nun Traingsdaten zu dem Thema gibst, werden die Outputs besser.

An tragfähigen Argumente zur Gegenposition zur Times wäre ich interessiert.

An tragfähigen Argumente zur Gegenposition zur Times wäre ich interessiert.

Aber ist es nicht dennoch ‚reproductive use‘?

Wenn ein Roman verfilmt wird, ist das oft eine freie Adaption des Originals, aber eindeutig IP.

Oder nimm manche Heil- oder Coching Methoden: Man zahlt für das erlernen und wendet sie später gegen Gebür an.

Aber ist es nicht dennoch ‚reproductive use‘?

Wenn ein Roman verfilmt wird, ist das oft eine freie Adaption des Originals, aber eindeutig IP.

Oder nimm manche Heil- oder Coching Methoden: Man zahlt für das erlernen und wendet sie später gegen Gebür an.

Wie ist deine Argumentation die zu so einer eindeutigen Einschätzung kommt?

Ich finde die Frage deutlich nuancierter und wäre gespannt deine Argumente zu hören.

Wie ist deine Argumentation die zu so einer eindeutigen Einschätzung kommt?

Ich finde die Frage deutlich nuancierter und wäre gespannt deine Argumente zu hören.

And yes, my catholic school & reading the bible introduced me to violence before movies and other books and video games. But hey… 🤷♂️

And yes, my catholic school & reading the bible introduced me to violence before movies and other books and video games. But hey… 🤷♂️